Helm.ai stellt WorldGen-1 vor, das erste generative Multisensor-KI-Grundlagenmodell seiner Art für autonomes Fahren

Helm.ai stellt WorldGen-1 vor, das erste generative Multisensor-KI-Grundlagenmodell seiner Art für autonomes Fahren

REDWOOD CITY, Kalifornien--(BUSINESS WIRE)--Helm.ai, ein führender Anbieter von KI-Software für High-End-ADAS, autonomes Fahren der Stufe 4 und Robotik, hat heute die Einführung eines generativen KI-Grundmodells mit mehreren Sensoren zur Simulation des gesamten autonomen Fahrzeugs bekannt gegeben. WorldGen-1 synthetisiert hochrealistische Sensor- und Wahrnehmungsdaten über mehrere Modalitäten und Perspektiven gleichzeitig, extrapoliert Sensordaten von einer Modalität zur anderen und sagt das Verhalten des Ego-Fahrzeugs und anderer Agenten in der Fahrumgebung voraus. Diese KI-basierten Simulationsfunktionen rationalisieren die Entwicklung und Validierung von autonomen Fahrsystemen.

WorldGen-1 nutzt innovative generative DNN-Architekturen und Deep Teaching, eine hocheffiziente, unbeaufsichtigte Trainingstechnologie, und wurde mit Tausenden von Stunden unterschiedlicher Fahrdaten trainiert, die alle Ebenen des autonomen Fahrens abdecken, einschließlich Vision, Wahrnehmung, Lidar und Odometrie.

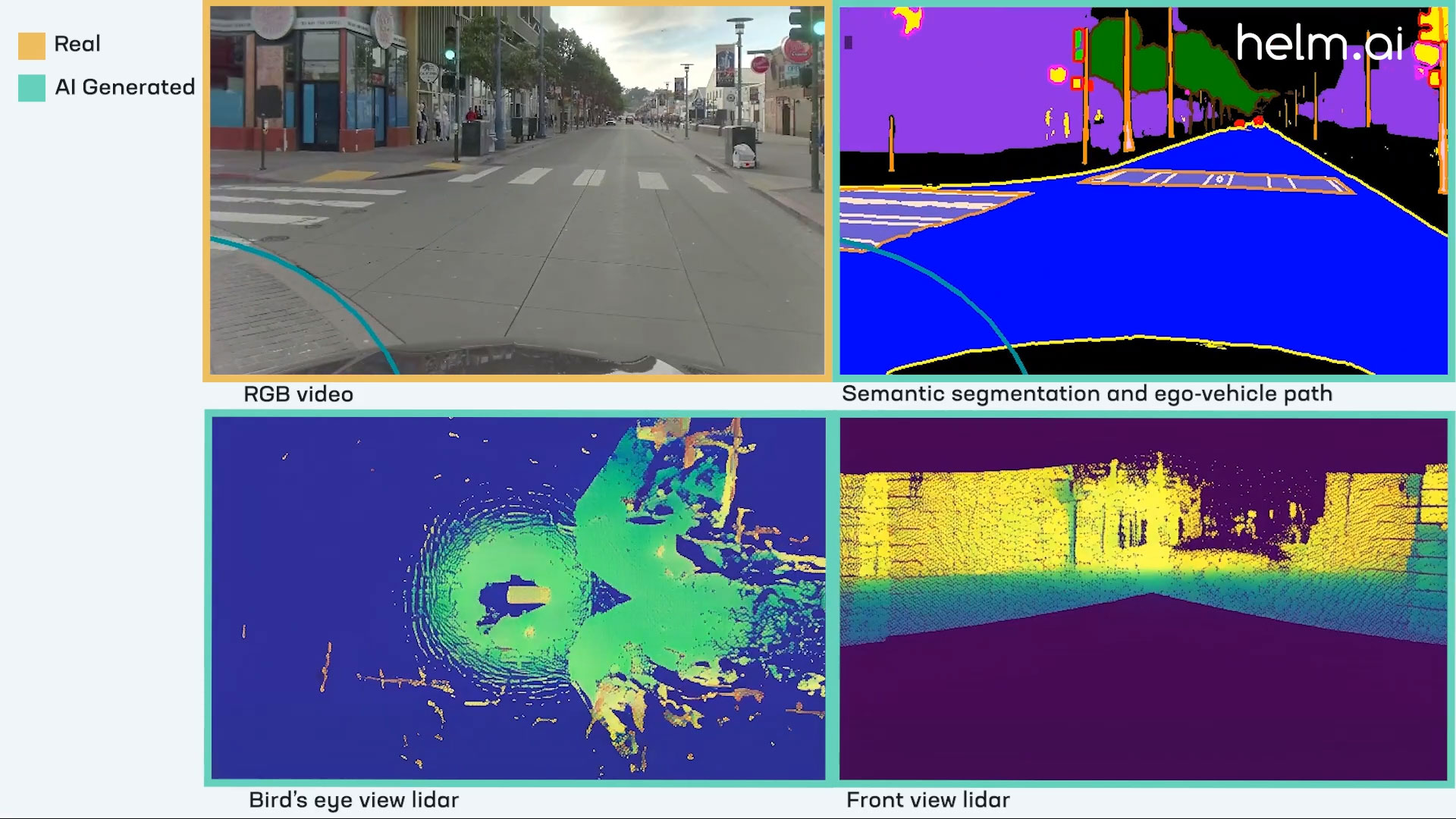

WorldGen-1 generiert gleichzeitig hochrealistische Sensordaten für Surround-View-Kameras, semantische Segmentierung auf der Wahrnehmungsebene, Lidar-Frontansicht, Lidar-Vogelperspektive und den Weg des Ego-Fahrzeugs in physikalischen Koordinaten. Durch die konsistente Generierung von Sensor-, Wahrnehmungs- und Pfaddaten über den gesamten AV-Stack hinweg bildet WorldGen-1 potenzielle reale Situationen aus der Perspektive des selbstfahrenden Fahrzeugs genau nach. Diese umfassende Sensor-Simulationsfunktion ermöglicht die Generierung realitätsgetreuer, mit mehreren Sensoren gekennzeichneter Daten, um eine Vielzahl anspruchsvoller Sonderfälle zu lösen und zu validieren.

Darüber hinaus kann WorldGen-1 von realen Kameradaten auf mehrere andere Modalitäten extrapolieren, darunter semantische Segmentierung, Lidar-Frontansicht, Lidar-Vogelperspektive und den Weg des Ego-Fahrzeugs. Diese Fähigkeit ermöglicht die Erweiterung bestehender reiner Kameradatensätze in synthetische Multisensor-Datensätze, wodurch der Reichtum der reinen Kameradatensätze erhöht und die Kosten für die Datenerfassung gesenkt werden.

Über die Sensorsimulation und Extrapolation hinaus kann WorldGen-1 auf der Grundlage einer beobachteten Eingabesequenz das Verhalten von Fußgängern, Fahrzeugen und dem Ego-Fahrzeug in Bezug auf die Umgebung vorhersagen und dabei realistische zeitliche Abläufe von bis zu Minuten Dauer erzeugen. Dies ermöglicht die KI-Generierung eines breiten Spektrums möglicher Szenarien, einschließlich seltener Sonderfälle. WorldGen-1 kann auf der Grundlage von beobachteten Eingabedaten mehrere potenzielle Ergebnisse modellieren, was seine Fähigkeit zur fortgeschrittenen Multi-Agenten-Planung und -Vorhersage unter Beweis stellt. Das Verständnis der Fahrumgebung und die Vorhersagefähigkeit von WorldGen-1 machen es zu einem wertvollen Werkzeug für die Absichtsvorhersage und die Wegplanung, sowohl als Mittel zur Entwicklung und Validierung als auch als Kerntechnologie, die Fahrentscheidungen in Echtzeit trifft.

„Die Kombination von Innovationen im Bereich der generativen KI-Architekturen mit unserer Deep Teaching-Technologie führt zu einer hoch skalierbaren und kapitaleffizienten Form der generativen KI. Mit WorldGen-1 machen wir einen weiteren Schritt, um die Lücke zwischen Simulation und Realität beim autonomen Fahren zu schließen. Dies ist der Schlüssel zur Rationalisierung und Vereinheitlichung der Entwicklung und Validierung von High-End-ADAS- und L4-Systemen. Wir geben den Automobilherstellern ein Werkzeug an die Hand, mit dem sie die Entwicklung beschleunigen, die Sicherheit verbessern und die Lücke zwischen Simulation und realen Tests drastisch verringern können“, sagte Vladislav Voroninski, CEO und Mitbegründer von Helm.ai.

„Die Generierung von Daten aus WorldGen-1 ist wie die Schaffung einer riesigen Sammlung verschiedener digitaler Geschwister realer Fahrumgebungen auf dem Niveau des gesamten AV-Sensorstapels, vollgepackt mit intelligenten Agenten, die wie Menschen denken und Vorhersagen treffen, was uns in die Lage versetzt, die komplexesten Herausforderungen des autonomen Fahrens anzugehen“, fügte Voroninski hinzu.

Über Helm.ai

Helm.ai entwickelt die nächste Generation von KI-Software für High-End-ADAS, autonomes Fahren L4 und Robotik. Das 2016 gegründete Unternehmen mit Sitz in Redwood City, Kalifornien, hat eine neue Art der Entwicklung von KI-Software eingeführt, um wirklich skalierbares autonomes Fahren Realität werden zu lassen. Weitere Informationen über Helm.ai, einschließlich der Produkte, des SDK und offener Karrieremöglichkeiten, finden Sie unter https://www.helm.ai/. Folgen Sie auch Helm.ai auf LinkedIn.

Die Ausgangssprache, in der der Originaltext veröffentlicht wird, ist die offizielle und autorisierte Version. Übersetzungen werden zur besseren Verständigung mitgeliefert. Nur die Sprachversion, die im Original veröffentlicht wurde, ist rechtsgültig. Gleichen Sie deshalb Übersetzungen mit der originalen Sprachversion der Veröffentlichung ab.

Contacts

Medienkontakt

press@helm.ai